L’intelligenza artificiale sta cambiando il modo in cui elaboriamo i dati, e l’Edge AI rappresenta una delle evoluzioni più interessanti. Portare il calcolo vicino alla fonte dei dati significa ridurre la latenza, migliorare la privacy e aumentare la resilienza. In questo contesto, openSUSE Leap 15.6 si rivela una base solida per costruire un’infrastruttura AI distribuita, sfruttando la virtualizzazione con KVM, l’orchestrazione con K3s e l’inferenza locale con Ollama.

Il progetto presentato da Rudraksh Karpe durante il Google Summer of Code 2025 mostra come creare un cluster AI scalabile e autosufficiente, utilizzando hardware esistente e software open source. L’architettura si basa su nodi virtuali specializzati, storage distribuito con Longhorn e un sistema di monitoraggio completo con Prometheus e Grafana. L’obiettivo è eseguire modelli LLM direttamente in locale, senza dipendere da servizi cloud esterni.

Configurazione dei nodi virtuali con openSUSE Leap

Il primo passo consiste nella creazione di macchine virtuali con KVM, configurate per eseguire openSUSE Leap con impostazioni coerenti. Ogni nodo riceve un hostname specifico, una configurazione di rete statica e una disattivazione del firewall per facilitare la comunicazione interna. L’installazione dei pacchetti essenziali include strumenti per Kubernetes, filesystem avanzati e servizi iSCSI per lo storage.

Una volta configurato il sistema, si prepara il disco dedicato per Longhorn, il sistema di storage distribuito. Questo consente di condividere modelli AI e dati tra i nodi, garantendo alta disponibilità e ridondanza. Il reboot finale completa la preparazione del nodo, pronto per unirsi al cluster.

Integrazione con K3s e gestione del cluster

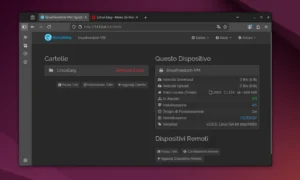

La gestione del cluster avviene tramite Rancher, che consente di creare un ambiente Kubernetes leggero e ottimizzato per l’Edge. Ogni nodo viene registrato con un token e un comando curl, entrando a far parte del cluster AI. La connettività viene verificata con kubectl, assicurandosi che tutti i pod siano attivi e funzionanti.

Questa configurazione permette di distribuire carichi di lavoro AI in modo dinamico, assegnando modelli e applicazioni in base alle risorse disponibili. I nodi possono essere etichettati per distinguere quelli con GPU da quelli ottimizzati per CPU, facilitando la distribuzione intelligente dei modelli.

Inferenza locale con Ollama e modelli LLM

Ollama è il cuore dell’inferenza AI locale. Installato su ogni nodo, consente di eseguire modelli LLM come Phi-3 direttamente in locale. La configurazione del servizio prevede l’apertura della porta 11434 e la definizione di variabili d’ambiente per l’accesso distribuito. I modelli vengono scaricati in base alla capacità del nodo: versioni quantizzate per sistemi con 8 GB di RAM, modelli più precisi per nodi con 16 GB o più.

Questa strategia consente di ottimizzare l’uso delle risorse, mantenendo elevate prestazioni anche su hardware limitato. L’inferenza avviene interamente in locale, garantendo che i dati non escano mai dall’infrastruttura, un vantaggio cruciale per applicazioni sensibili o industriali.

Monitoraggio, scaling e accesso ai servizi

Il sistema include una suite di monitoraggio con Prometheus e Grafana, accessibile via port forwarding. È possibile visualizzare metriche, dashboard e lo stato dei modelli AI in tempo reale. L’applicazione Streamlit per l’analisi edge viene distribuita tramite manifest Kubernetes, con endpoint configurati per interagire con Ollama.

Il cluster può essere scalato orizzontalmente, aggiungendo nuovi nodi e replicando i deployment. Le operazioni di aggiornamento dei modelli, verifica dello stato e bilanciamento del carico sono gestite tramite comandi kubectl, offrendo pieno controllo sull’infrastruttura.

openSUSE al centro dell’AI decentralizzata

Questa architettura dimostra come sia possibile costruire un’infrastruttura Edge AI potente, scalabile e completamente open source utilizzando openSUSE Leap, KVM, K3s e Ollama. L’approccio locale garantisce privacy, efficienza e indipendenza dal cloud, rendendo il sistema adatto a una vasta gamma di applicazioni, dalla ricerca scientifica all’industria.

Per chi sviluppa su Linux, questo progetto rappresenta una guida concreta per portare l’intelligenza artificiale al limite della rete, sfruttando al massimo le potenzialità del software libero. Il futuro dell’AI è distribuito, e openSUSE è pronta a guidarlo.